Cloudprovider AWS wil je graag helpen bij de ontwikkeling en integratie van generatieve AI-toepassingen. Daartoe lanceert het bedrijf verschillende oplossingen gericht op zowel training als inferentie.

AWS voelt zich niet comfortabel aan de zijlijn. De afgelopen weken en maanden gingen vooral Microsoft en in mindere mate Google lopen met de ene AI-primeur na de andere. Microsoft heeft dankzij zijn miljardenaandeel in OpenAI bovendien voorkeurstoegang tot de GPT-modellen van dat bedrijf. De verwevenheid tussen de generatieve AI-modellen en Azure is voor de fabrikant beslist een troef. Hoogtijd dus voor AWS om een antwoord te bieden.

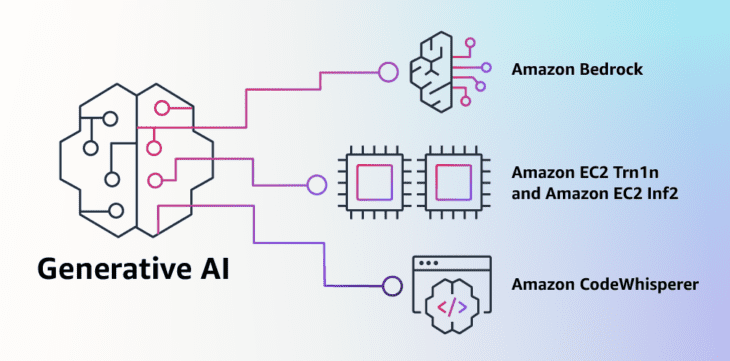

Dat neemt de vorm aan van vier verschillende diensten. AWS wil je daarbij helpen om zowel modellen te trainen als inferentie uit te voeren. De grote afwezige in heel het verhaal is OpenAI en bijgevolg het GPT-4-model, al biedt Amazon hiervoor wel de nodige alternatieven.

Bedrock

Eerst en vooral introduceert AWS Amazon Bedrock. Dat is een oplossing waarmee je zelf op grote schaal AI-toepassingen kan ontwikkelen op basis van modellen van AI21Labs, Anthropic, Stability AI en Amazon Titan. Bedrock laat klanten toe om modellen uit de lijst te trainen op basis van hun eigen gegevens. Dat gebeurt op basis van API’s.

lees ook

Microsoft 365 Copilot maakt Powerpoint-presentaties en Word-documenten in een handomdraai

De beschikbare modellen zijn zowel geschikt voor tekstgeneratie als voor beelden. Onder de Amazon Titan-vlag lanceert AWS zelf twee nieuwe large language models (LLM’s). Van AI21Labs zet AWS de Jurassic-2-modellen in de kijker. Die zijn geschikt voor tekst en kunnen specifiek goed om met Europese talen zoals Spaans, Frans, Duits, Portugees en ook Nederlands.

Via Bedrock kunnen gebruikers modellen snel naar hun hand zetten. Het volstaat om naar een handvol voorbeelden te wijzen om het model aan te passen op maat van de noden van je bedrijf. AWS geeft het voorbeeld van een modewinkel die een model toegang geeft tot de taglines van de meest succesvolle marketingcampagnes voor handtassen de afgelopen jaren. Op basis van die informatie kan het model dan een nieuwe campagne genereren, die rekening houdt met de succesfactoren.

Instances

Vervolgens introduceert AWS nieuwe instances voor zowel training als inferentie van generatieve AI. Voor inferentie gaat het om Amazon EC2 Inf2-instances, gebouwd rond de Inferentia2-chips. Die zijn geoptimaliseerd voor generatieve AI en zouden een vier keer hogere doorvoer en tien keer lagere latency hebben dan hun voorgangers. AWS claimt dat de verhouding tussen prijs en prestatie er met 40 procent op vooruitgaat.

De Trn1n-instances zijn dan weer bedoeld voor training. Ook die instances hebben accelerators van eigen makelij aan boord: de Trainium-chips. Gebruikers kunnen instances combineren tot zogenaamde UltraClusters met tot 30.000 van dergelijke Trainium-chips aan boord. Die configuratie is goed voor meer dan zes exaflops aan AI-rekenkracht.

Copilot-concurrent

Tot slot lanceert AWS Amazon CodeWhisperer. Dat is een concurrent voor de GitHub Copilot die net als de concurrent van Microsoft in staat is om programmeurs te helpen door code te suggereren. CodeWhisperer maakt uiteraard ook gebruik van generatieve AI en kan vandaag al Python, Java, JavaScript, TypeScript en C#.

CodeWhisperer werd vorig jaar al gelanceerd maar is nu algemeen beschikbaar. Met die bredere lancering voorziet AWS ook compatibiliteit met tien nieuwe talen, waaronder Kotlin, Rust, PHP, en SQL.

Relevante aankondigingen

De reeks aankondigingen van AWS is breed en toont aan dat de cloudprovider er als de dood voor is om de AI-trein te missen. AWS heeft heel wat unieke interne capaciteiten, waaronder de mogelijkheid om eigen krachtige acceleratorchips op maat te ontwikkelen. De instances voor training en inferentie maken daar dankbaar gebruik van. De aankondigingen komen bovendien net op tijd, aangezien AWS pas een AI-acceleratorprogramma aankondigde.

Ook Bedrock lijkt flink wat meerwaarde te bieden. De API-aanpak en de mogelijkheid om modellen naar je hand te zetten aan de hand van een beperkte set voorbeelden, spreekt aan. Het vergt niet veel verbeelding om daar de praktische meerwaarde in te zien.

Verder heeft AWS gelijk dat OpenAI met zijn GPT-modellen niet de enige is met krachtige LLM die de basis kunnen vormen van generatieve AI. Op die manier biedt het diverse aanbod een meerwaarde, al kunnen we ons niet van de indruk ontdoen dat het aanbod completer zou zijn met een samenwerking met OpenAI. ChatGPT is nu éénmaal de hype van het moment. De nauwe samenwerking van dat bedrijf met Microsoft en Azure geeft die grote concurrent op dit moment toch iets meer gezag en geloofwaardigheid als het op AI-training en inferentie in de cloud aankomt.