Het tekst-naar-beeld systeem krijgt een eerste, beperkte, toepassing in Google’s AI Test Kitchen-app.

Google zet een eerste, zij het kleine, stap om beeldgenerator Imagen beschikbaar te maken voor het grote publiek. In tegenstelling tot concurrenten DALL-E 2 (OpenAI) en Stable Diffusion (Stability AI) is Google tot nu heel voorzichtig geweest met de beeldgenerator. Nu heeft de techgigant het model in gelimiteerde vorm toegevoegd aan de AI Test Kitchen-app.

Feedback van gebruikers

Google lanceerde Test Kitchen eerder dit jaar, met als doel het taalmodel LaMDA te testen op een groter publiek. LaMDA, inderdaad, dat is het taalmodel waarvan een Google ingenieur beweerde dat de chatbot een bewustzijn heeft. Die uitspraak kostte de brave man uiteindelijk zijn job. De toevoeging van Imagen aan de app past in een tweede updateronde. Google wil met de implementatie feedback krijgen van de gebruikers.

Het is niet duidelijk hoeveel, en welke soort, gebruikers toegang hebben gekregen tot Imagen. “Het is een actieve, opinierijke groep van onderzoekers en beleidsmakers”, geeft Josh Woodward, SD product management bij Google aan. “Zij kunnen de toepassing gebruiken zodat wij meer inzichten krijgen in de beperkingen en mogelijkheden van AI-modellen.”

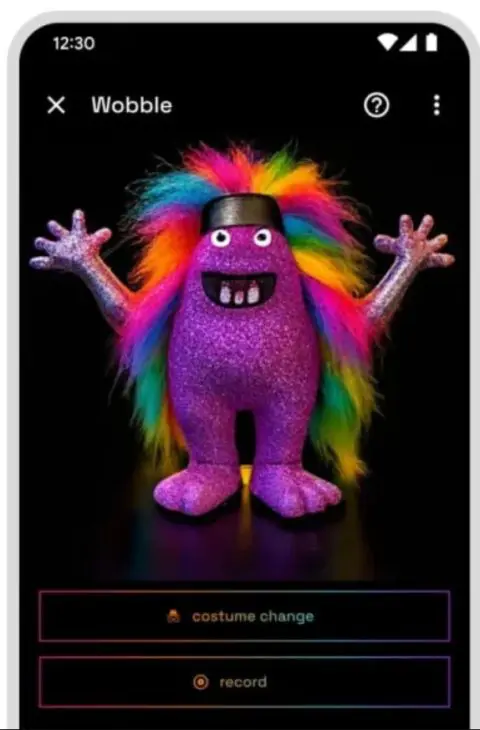

City Dreamer en Wobble

De gelukkige gebruikers zullen op twee manieren in dialoog kunnen gaan met Imagen. In City Dreamer kan het model een stadsmodel creëren volgens een gekozen thema. Imagen maakt gebouwen, stadsindelingen, luchthavens, enzovoort. De beelden lijken heel sterk op wat je krijgt in SimCity. Deze toepassing zou in een latere fase interessant kunnen zijn voor creative professionals.

In Wobble maken de gebruikers een monstertje. Ook hier kiest het programma, op basis van de input, hoe dat beestje er uit zal zien. Eens de lay-out compleet, dan maakt het monstertje een dansje. Zoals we al aangaven, de mogelijkheden voor het brede publiek zijn op dit moment eerder beperkt te noemen. “Het opzet is om feedback te krijgen maar ook om te zien hoe gebruikers het systeem eventueel kunnen kraken”, aldus Woodward.

Daarmee doelt de Google-topman op mogelijke foutjes omdat mensen vaak een verschillende interpretatie hebben van één bepaald woord of een bepaalde plaats. The Verge haalt het voorbeeld van Dachau aan. Een persoon die op zoek is naar een beeld van de middeleeuwse stad, wil niet plots een concentratiekamp op het scherm krijgen. De juiste interpretatie maken van een input blijft trouwens voor alle AI-modellen een uitdaging.