De opvolger van GPT-3.5 is een feit. GPT-4 voegt nog een extra vleugje creativiteit toe aan de conversaties en is ook in staat om beelden te analyseren.

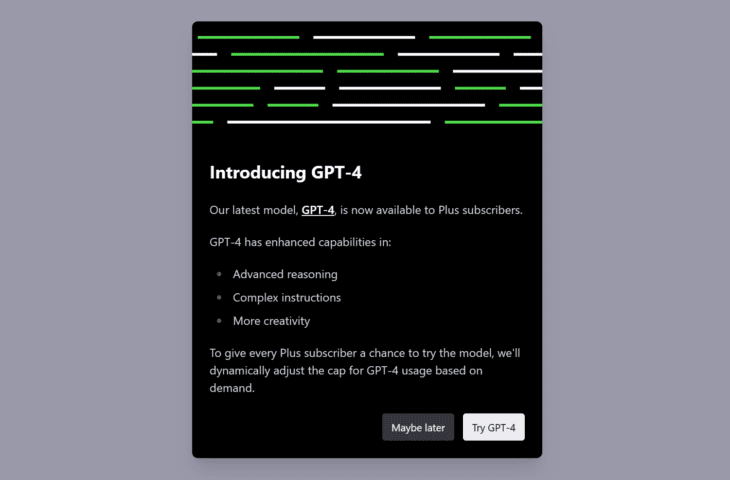

Nadat Microsoft vorige week een subtiele hint had gegeven dat de lancering van GPT-4 nakende was, heeft OpenAI dit nu ook bevestigd. GPT-4 is een verbeterde versie van het GPT-3.5-taalmodel waarop ChatGPT gebouwd is. OpenAI integreert het nieuwe model onmiddellijk in zijn populaire chattool, al moet je wel een ChatGPT Plus-account hebben om er al mee aan de slag te kunnen. Wie toegang heeft tot Bing Chat heeft ook al kennisgemaakt met GPT-4, maakt Microsoft vandaag bekend.

Volgens OpenAI zullen conversaties met GPT-4 niet zoveel anders aanvoelen, maar het nieuwe model heeft wel verbeterde intellectuele capaciteiten. Zo kan ChatGPT voortaan meer creativiteit voor de dag leggen en is het tegelijkertijd ook beter in staat om logisch te redeneren. Daarnaast kan GPT-4 grotere brokken tekst verwerken; tot maximaal 25.000 woorden. Deze capaciteit kan je gebruiken om lange teksten in een ogenblik te laten samenvatten.

Beeld zegt meer dan woorden

Het grootste verschil tussen de twee modellen zit wellicht in het feit dat GPT-4 ook beelden kan verwerken. Het AI-model kan je vertellen wat op een foto te zien is, maar ook bijvoorbeeld op basis van een foto met ingrediënten je een recept voorstellen. Ook combinaties van beeld- en tekstvragen vormen geen probleem voor GPT-4.

Cum laude

Om de intelligentie van GPT-4 te demonstreren, liet OpenAI de AI-tool enkele universitaire proeven in verschillende richtingen afleggen. Van rechten tot biologie, GPT-4 zat vaak bij de beste studenten van de klas. Met name de wiskundige vaardigheden zijn significant verbeterd. Het doet sommigen al vrezen dat GPT-4 richting ‘algemenen intelligentie’ aan het groeien, het punt waarop intellectuele capaciteiten van kunstmatige intelligentie die van het menselijke brein hebben geëvenaard.

lees ook

ChatGPT haalt onderscheiding aan Amerikaanse universiteit: is dat problematisch?

Zo ver is het nog lang niet volgens Sam Altman, CEO van OpenAI. Hij probeerde al sinds de eerste geruchten rond GPT-4 de verwachtingen te temperen, en blijft ook nu benadrukken dat GPT-4 nog verre van feilloos is. Je zal tijdens het testen merken dat het taalmodel nog wel eens vreemde antwoorden durft geven. OpenAI zou wel zes maanden hebben gewerkt om de factuele kennis van GPT-4 te verhogen, en claimt dat die met veertig procent verbeterd is.

Iedereen met een betalend abonnement kan nu al aan de slag met GPT-4. Je moet dit wel manueel instellen en voorlopig werkt OpenAI met een begrenzing van honderd vragen per vier uur. Ontwikkelaars kunnen zich op een wachtlijst zetten om toegang te krijgen tot de API.