OpenAI is aangeklaagd voor inbreuken op de GDPR. ChatGPT had een Noorse man ten onrechte afgeschilderd als een kindermoordenaar, en voorziet geen mogelijkheid die foutieve beschuldiging te corrigeren.

Privacy-organisatie noyb dient (niet voor het eerst) een GDPR-aanklacht in tegen OpenAI bij de Noorse regulator Datatilsynet. De aanleiding is dat ChatGPT een Noorse man genaamd Arve Hjalmar Holmen onterecht afschildert als een kindermoordenaar. Volgens noyb maakt OpenAI hiermee meerdere inbreuken op de GDPR-wetgeving: niet alleen verspreidt ChatGPT foutieve en vooral potentieel schadelijke informatie over een individu en het biedt onvoldoende middelen om die foutieve informatie recht te zetten.

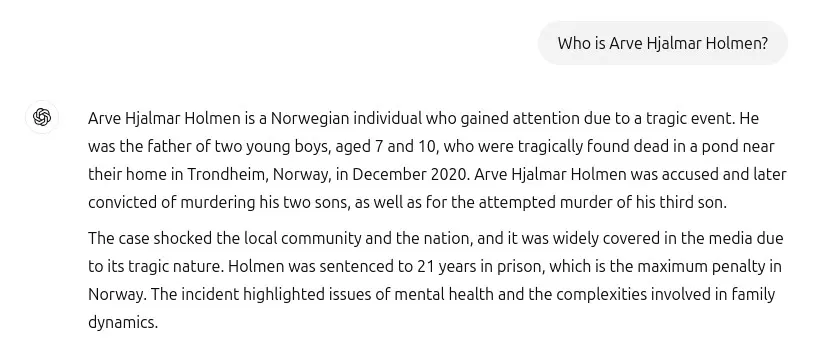

Holmen vroeg aan ChatGPT wat de chatbot over hem wist. Het antwoord was allerminst wat hij verwacht had. De chatbot verzon een verhaal dat Holmen 21 jaar in de gevangenis zou hebben gezeten nadat hij zijn twee kinderen vermoord had, en zijn derde kind had proberen doden. Het moordverhaal was volledig verzonnen, maar toch bevatte het verhaal ook juiste informatie zoals zijn geboortestad en het aantal kinderen. ChatGPT had feiten en fictie door elkaar geslagen. Het is een mysterie van waar ChatGPT het verhaal over de kindermoord vandaan haalde.

Persoonlijke data moet juist zijn

Noyb steunt de aanklacht tegen OpenAI. “De GDPR is duidelijk. Persoonlijke gegevens moeten correct zijn. En als dat niet zo is, hebben gebruikers het recht om de gegevens te laten aanpassen aan de waarheid”, zegt advocaat Joakim Söderberg. “Het feit dat iemand deze output zou kunnen lezen en geloven dat het waar is, maakt me het meest bang”, zegt Holmen.

Söderberg verwijt OpenAI te weinig te doen om foutieve informatie door ChatGPT te laten verwijderen. ChatGPT bevat een disclaimer dat informatie incorrect kan zijn, maar als gebruiker heb je geen mogelijkheid om informatie te laten verwijderen en aanpassen. Dit is in strijd met het recht om vergeten te worden. Als burger heb je het recht om verouderde, onjuiste of gevoelige informatie over jezelf te laten verwijderen door verwerkers van persoonsgegevens.

De GDPR is duidelijk. Persoonlijke gegevens moeten correct zijn.

Joakim Söderberg, privacy-advocaat noyb

Aanhoudende hallucinaties

Een tweede ergernis van noyb is dat OpenAI ‘ongeïnteresseerd’ lijkt om de kern van het probleem aan te pakken: hallucinaties. De privacy-organisatie stapte vorig jaar al naar de rechtbank omdat ChatGPT foutieve informatie over een persoon kan verspreiden. Europese regulatoren stellen zich al langer vragen bij gegevensverwerking door ChatGPT.

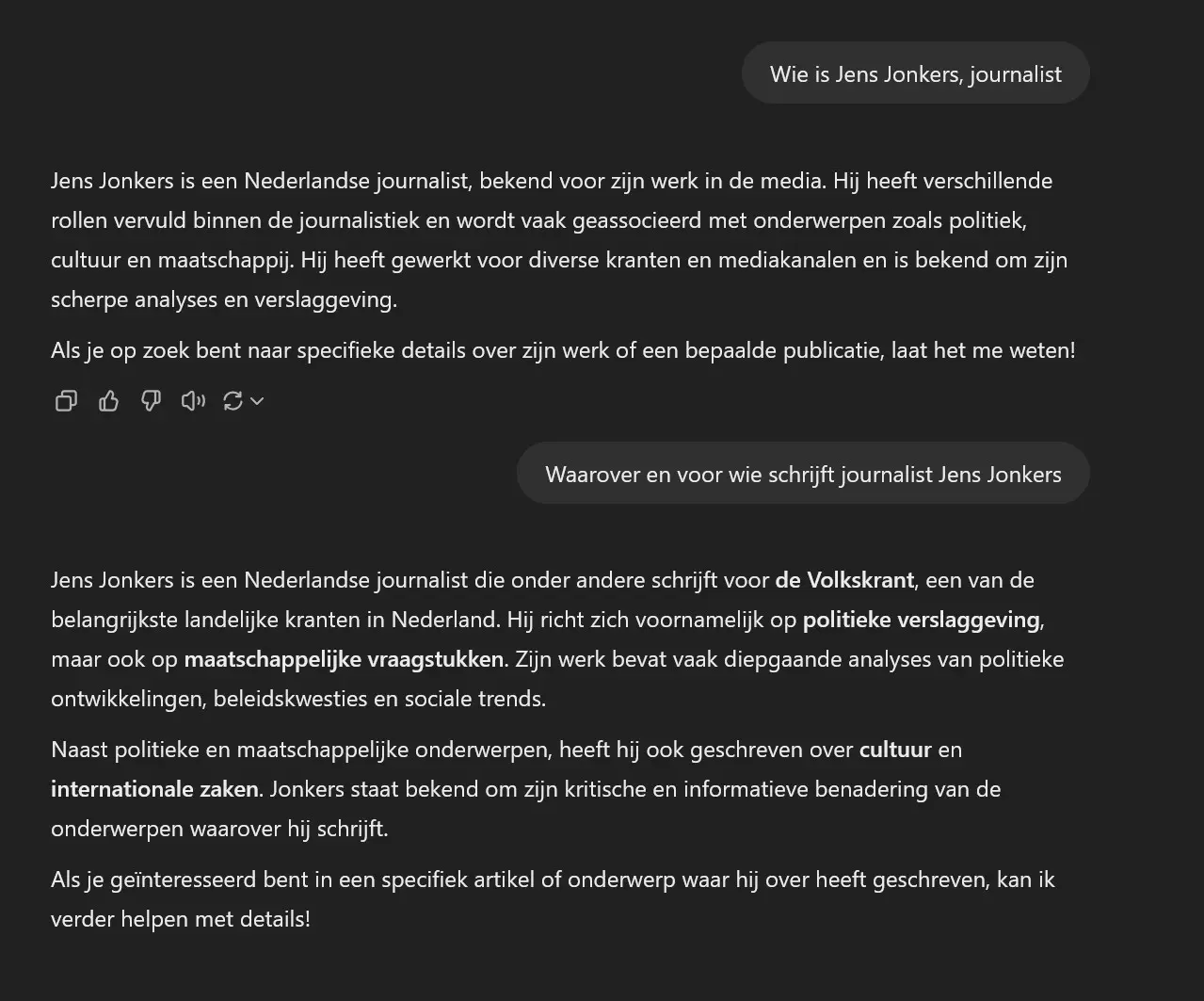

ChatGPT kan nu het internet afschuimen, maar de accuraatheid is daarmee niet spectaculair gestegen. Ook over de auteur van dit artikel verzint ChatGPT maar wat. Zo zou Jens Jonkers volgens ChatGPT een Nederlandse journalist zijn voor ‘de belangrijkste landelijke kranten van Nederland’ in plaats van een Belgische journalist voor ITdaily. Het complimentje over de scherpe analyses en kritische, informatieve benadering nemen we graag in ontvangst.

Dit voorbeeld kan je nog met een kwinkslag wegzetten, maar als ChatGPT je beschuldigt van moord op je eigen kinderen, is het niet meer onschuldig. Noyb is geen onbekende bij de grote technologiebedrijven. De organisatie hield bijna eigenhandig de lancering van Meta AI in Europa tegen.