Apple mengt zich mee in de AI-debatten met MGIE, een AI-model dat op basis van tekstomschrijvingen beelden bewerkt. Het is nog onduidelijk of en hoe Apple dit naar zijn producten wil brengen.

Het heeft even op zich laten wachten, maar Apple doet nu ook mee met de AI-hype. In een onderzoekpaper stellen wetenschappers gelinkt aan het iPhone-bedrijf MGIE voor. Die afkorting staat languit voor MLLM-Guided Image Editing. Het is gebouwd op een multimodaal LLM dat tegelijkertijd tekst en beeld kan verwerken.

Beelden bewerken

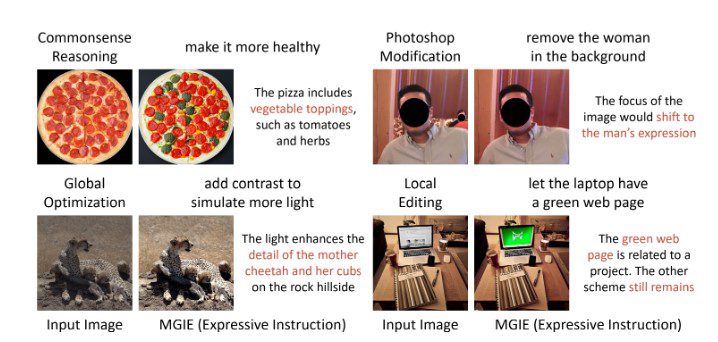

In de praktijk kan je het model gebruiken om beelden aan te passen naar wens. Je kan er onder andere elementen mee toevoegen, vervangen of verwijderen van een foto, maar ook de scherpte en belichting aanpassen. Enkele voorbeelden die Apple geeft in de paper of is een pizza die gezonder wordt gemaakt door er kunstmatig groenten op te leggen, of een plateau donuts die verandert in een pizza om in hetzelfde thema te blijven. Wat het model niet kan, is op basis van een tekstomschrijving zelf een beeld maken, zoals Dall-E 3.

Je kan het model zelf eens uittesten op Hugging Face. Je moet wel even geduld hebben: de tool raakt snel overbelast waardoor wachttijden kunnen oplopen tot 6000 seconden(!). MGIE is in deze fase dan ook vooral een experiment waarmee Apple wil laten zien dat het ook mee is met generatieve AI. Wat Apple er op termijn mee van plan is, valt af te wachten. De Google Pixel 8 en Samsung Galaxy S24 komen al met uitgebreide AI-beeldbewerkingsfuncties, dus er ligt wel potentieel voor een model als MGIE op de iPhone.