Nvidia onthult met Rubin CPX een nieuwe GPU, op maat gebouwd voor inferentietaken waarbij veel context en dus de verwerking van veel tokens belangrijk is.

Nvidia toont Rubin CPX. Dat is volgens de fabrikant zelf een nieuwe klasse van GPU. De chip is ontwikkeld op maat van inferentietaken waarbij een grote context van belang is.

De context verwijst naar het aantal parameters dat relevant is voor een inferentietaak (het genereren van een AI-antwoord). Complexe workloads zoals videogeneratie vereisen een grote context en de snelle verwerking van enorme hoeveelheden tokens (AI-databrokken). Een uur aan kwalitatieve video genereren kost bijvoorbeeld één miljoen tokens. Met Rubin CPX zet Nvidia een chip in de markt die gespecialiseerd is in dergelijke inferentie met massieve contextvereisten.

De chip levert tot 30 petaFlops aan AI-rekenkracht, al rekent Nvidia met het eigen NVFP4-datatype wat dat cijfer eerder arbitrair maakt. De chip heeft 128 GB aan GDDR7-geheugen aan boord. Nvidia kiest niet voor HBM omdat GDDR7 kostenefficiënter is, en volstaat voor inferentie.

Totaalplatform

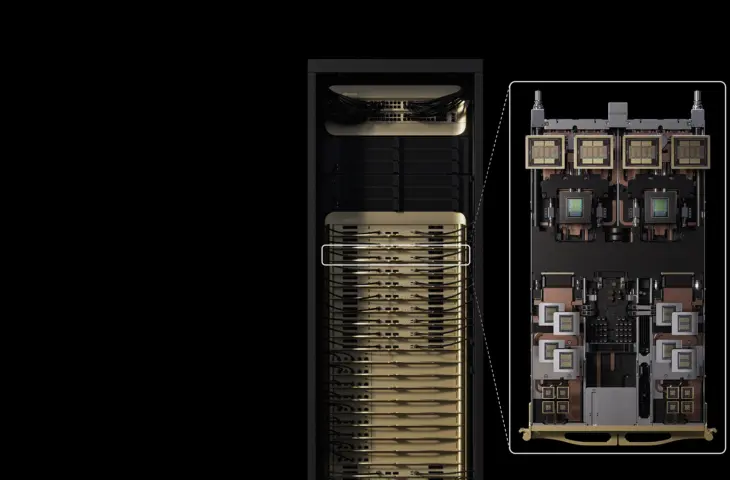

Nvidia combineert de Rubin CPX-chip met Vera-CPU’s en Rubin-GPU’s in het Nvidia Vera Rubin NVL144 CPX-platform. Dat is een geïntegreerde oplossing goed voor acht exaFlops aan (Nvidia’s eigen NVFP4-)AI-compute. De accelerator is compatibel met Nvidia’s eigen AI-softwarestack.

Nvidia mikt op grote klanten (en hoge omzet) met de oplossing. Het bedrijf merkt op dat iedere honderd miljoen dollar aan investering in Rubin CPX-systemen kan leiden tot vijf miljard dollar aan opbrengst op basis van tokens. Die ietwat arbitraire rekensom toont wel de schaal die Nvidia in gedachten heeft. Nvidia Rubin CPX moet aan het einde van 2026 effectief op de markt komen.