Via Bugcrowd kunnen hackers tussen de 200 dollar en 20.000 dollar buitmaken wanneer ze een kwetsbaarheid vinden.

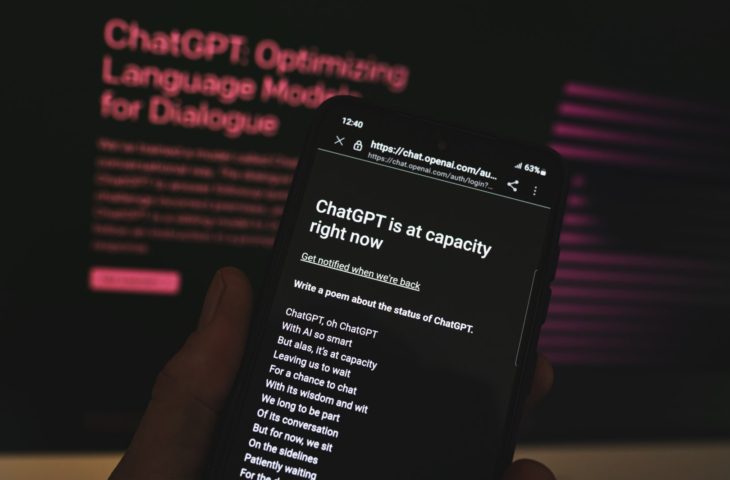

OpenAI, het bedrijf achter ChatGPT en DALL-E, gaat samenwerken met bug bounty-platform Bugcrowd om zijn AI-modellen te testen. Via het platform kunnen white hat-hackers kwetsbaarheden, bugs of veiligheidslekken ontdekken in de systemen van OpenAI. Hoe ernstiger de bug, hoe meer geld verdiend wordt. Beloningen variëren tussen de 200 dollar en 20.000 dollar.

Hackers hoeven niet op zoek te gaan naar problemen binnen het AI-model of zaken die niet gerelateerd zijn met cybersecurity volgens OpenAI. Bugcrowd noteert dat problemen binnen een model niet individuele discrete bugs zijn. Die zijn zelden direct herstelbaar, vereisen meer onderzoek en een bredere aanpak.

Onderzoekers, white hat-hackers, moeten goed de spelregels lezen voordat ze aan de slag gaan. Zo moeten ze erop letten dat ze correct kwetsbaarheden rapporteren, geen systemen mogen platleggen of data vernietigen. Elke kwetsbaarheid die wordt gerapporteerd, moet tot 90 dagen geheim blijven zodat OpenAI de tijd krijgt om het lek te dichten. Deze regels worden wel vaker gehanteerd binnen bug bounty-platformen.

lees ook

GPT-4 onder de loep: beelden lezen, talenknobbel en meerdere persoonlijkheden

Het is goed nieuws dat OpenAI budget stopt in het verbeteren van zijn systemen. Eind vorige maand was er nog een privacybug waar je chatgegevens van een andere gebruiker zag wanneer je was ingelogd. Dergelijke zaken moeten eruit wil de dienst volwassen worden. Tegelijk worstelt ChatGPT met de GDPR-regels nu na Italië ook Frankrijk, Duitsland en Ierland naar een potentieel verbod op ChatGPT kijken.