Microsoft demonstreert VALL-E, een technologie die stemmen realistisch kan nabootsen op basis van korte opnames. Het AI-model is zelfs getraind om emoties te reproduceren.

Het zijn interessante tijden voor wie de laatste ontwikkelingen in artificiële intelligentie volgt. Nadat OpenAI indrukt maakte met Dall-E en ChatGPT, is het nu aan Microsoft om uit te pakken met een knap staaltje AI. Via GitHub geeft Microsoft een demonstratie van VALL-E, een AI-systeem dat stemmen kan nabootsen.

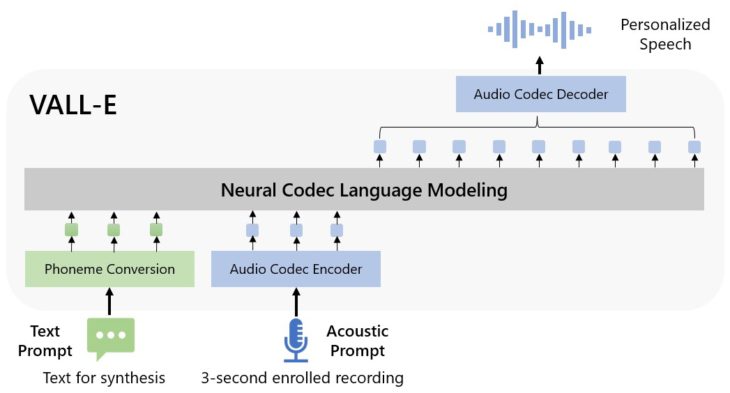

VALL-E is een neuraal taalmodel dat bedoeld is voor tekst-naar-spraaksynthese. In een onderzoekpaper staat te lezen dat het model getraind werd met voor meer dan zestigduizend uur aan spraakopnames in de Engelse taal. Daardoor is het model nu al in staat om op basis van een opname van slechts drie seconden iemands stem vrij realistisch te imiteren.

Het model van Microsoft is zeker niet de eerste van zijn soort, maar eerdere AI-spraakmodellen klonken tot nu toe altijd nog zeer robotachtig. De output die VALL-E levert, klinkt veel natuurlijker en komt ook beter overeen met de spreker. We raden je aan om enkele opnames te beluisteren en zelf te oordelen.

Emoties en akoestiek

VALL-E is bovendien ook getraind om emoties en de omgevingsakoestiek mee op te nemen. Als het model een opname van een telefoongesprek voorgeschoteld krijgt, dan zal het de stem ook reproduceren alsof die door een telefoon komt.

Met emoties natuurlijk te laten weerklinken, heeft het model nog veel moeite. In de demo zitten enkele fragmenten waar VALL-E woede, moeheid, vreugde en walging probeert na te bootsen. Je hoort onmiddellijk dat deze emoties zeer gemaakt klinken en het resultaat is beter als de stem neutraal is.

Doembeelden

De schoonheidsfoutjes ten spijt, is de vooruitgang van VALL-E indrukwekkend te noemen. De geproduceerde stemmen klinken over het algemeen zeer realistisch. Zo realistisch dat doemdenkers nu al van zich laten horen. Zo wordt er gevreesd dat technologieën zoals VALL-E kunnen worden ingezet in de verspreiding van misinformatie, omdat je zo nog makkelijker mensen woorden kan laten uitspreken die ze nooit gezegd hebben.

lees ook

ChatGPT helpt hackers met ontwikkelen van malware

De onderzoekers zijn zich bewust van ethische complicaties en roepen op tot protocollen die ervoor moeten zorgen dat de spreker altijd zijn of haar toestemming kan geven voor het gebruik en bewerken van opnames. Voorlopig lijkt het er ook nog niet naar dat VALL-E beschikbaar komt voor het grote publiek. Microsoft onderzoekt wel al volop hoe het met ChatGPT AI-technologie kan integreren in Office en Bing.